Um dos crimes mais repugnantes que existe é a violência sexual, em se tratando de crianças e adolescentes, o grau de horror e repugnância é imensurável. Nos últimos dois anos, até março de 2022, segundo dados da Secretaria de Estado de Justiça e Segurança Pública (Sejusp) de Minas Gerais, ocorreram mais de 5.700 crimes contra a dignidade sexual de crianças de zero a 11 anos e, no mesmo período, mais de 8.700 contra adolescentes (12 a 17 anos). Com o intuito de ajudar a combater este mal que destrói a vida de milhares de jovens todos os anos, foi criado o Dia Nacional de Combate ao Abuso e à Exploração Sexual de Crianças e Adolescentes. A data, 18 de maio, foi escolhida em memória do “Caso Araceli”, um crime que chocou o país na época. Araceli Crespo era uma menina de apenas oito anos de idade, que foi violada e violentamente assassinada em Vitória, no Espírito Santo, no dia 18 de maio de 1973. Assim, foi instituído oficialmente o dia no país através da lei nº 9.970, de 17 de maio de 2000.

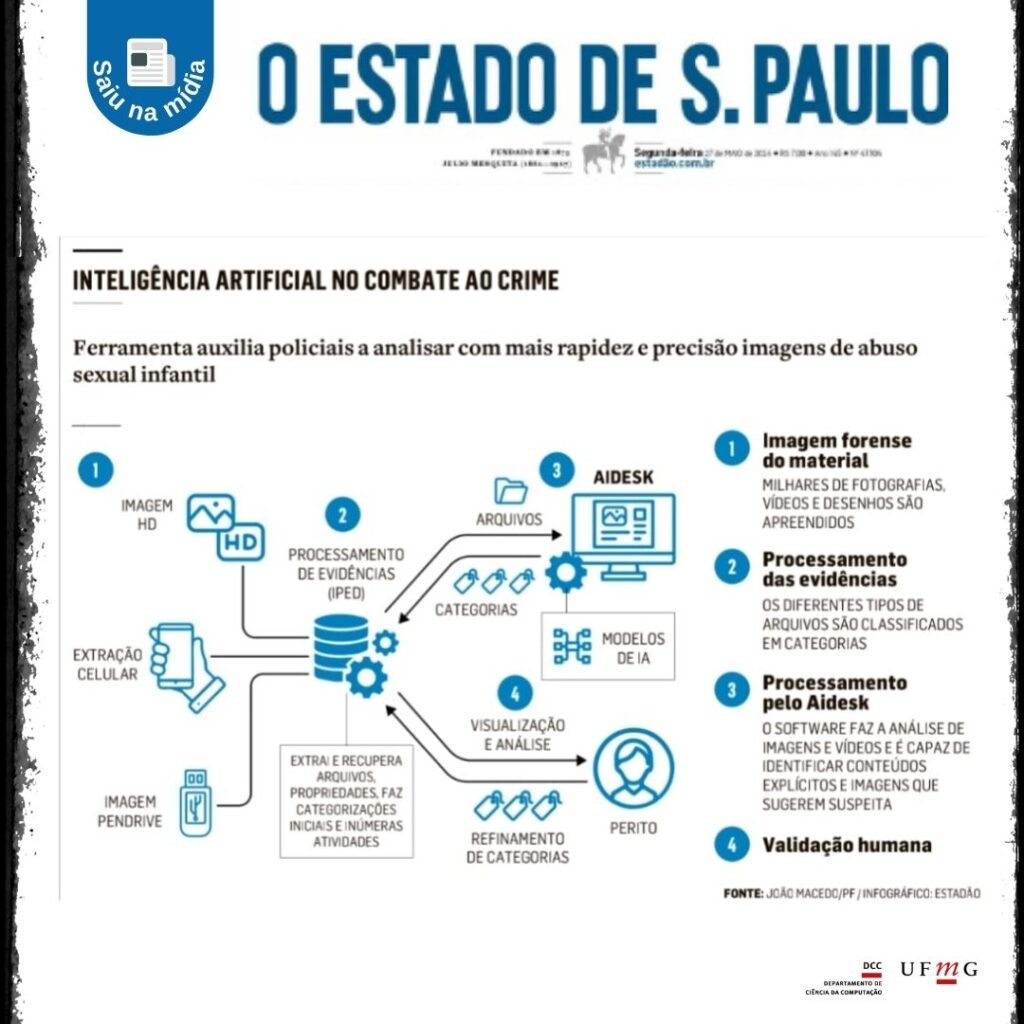

O compartilhamento e visualizações on-line de abuso infantil (CSAM) está crescendo rapidamente e, para investigar os casos, as polícias e demais órgãos investigativos, têm um trabalho árduo, necessitando analisar e classificar um grande número de imagens. Esse trabalho envolve a inspeção visual de um grande número de imagens e vídeos encontrados em computadores ou celulares dos investigados. Por outro lado, a maioria dos métodos atuais é baseada no hash das imagens (que funcionam como identificadores únicos das imagens) ou em detecção de cor de pele. O primeiro deles depende de uma grande base de hashes de arquivos previamente conhecidos e não possibilita a detecção de imagens não catalogadas previamente ou que sofreram até mínimas modificações. O segundo método, por sua vez, gera um grande número de falsos positivos, daí a necessidade de pesquisa e desenvolvimento de métodos de detecção mais eficientes e capazes de detectar novos arquivos relacionados a este tipo de crime independentemente de um catálogo prévio.

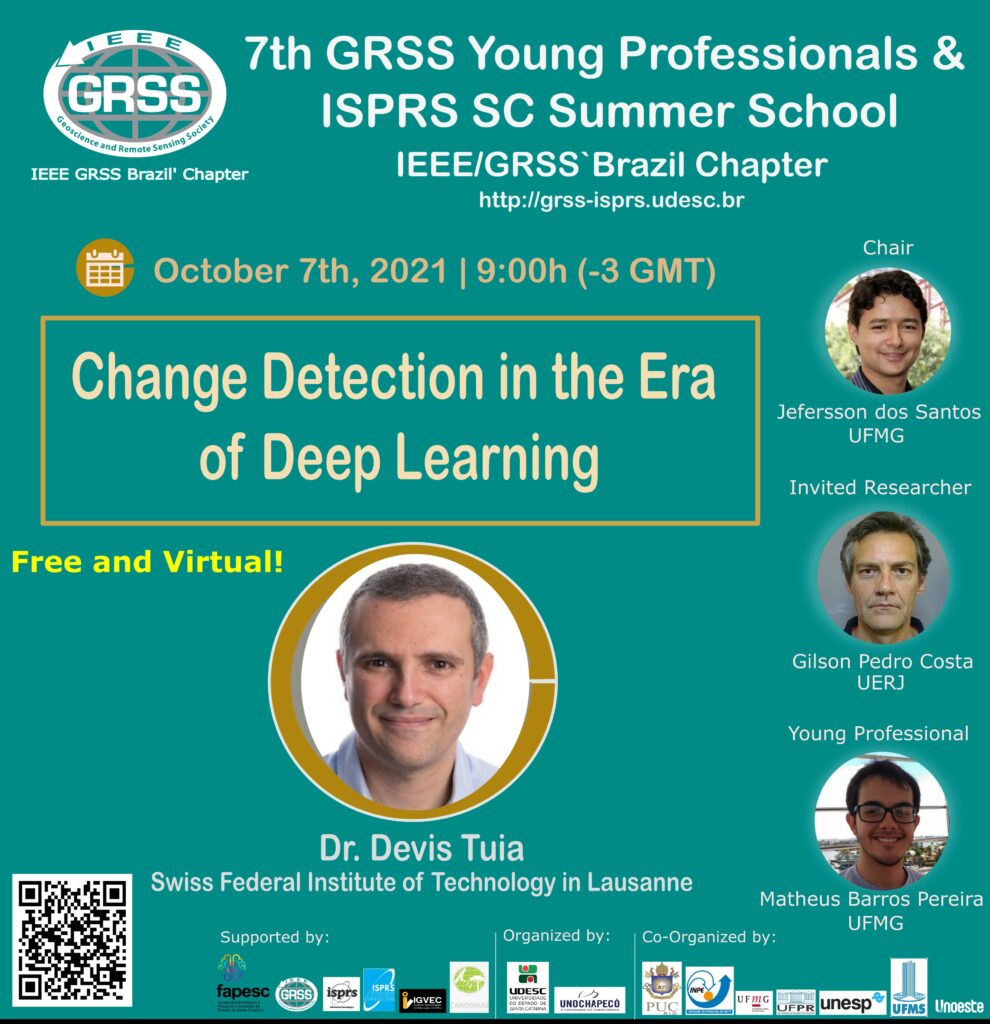

Para auxiliar o trabalho dos pesquisadores que lidam com o assunto e com o intuito de prover a melhoria e agilidade aos métodos investigativos, a doutoranda Camila Laranjeira, em parceria com o também doutorando, João Macedo, ambos do Laboratório PATREO do Departamento de Ciência da Computação da Universidade Federal de Minas Gerais (DCC/UFMG), além dos professores Sandra Avila e Jefersson Alex dos Santos, do Instituto de Computação da UNICAMP e do DCC/UFMG, respectivamente, pesquisaram e propuseram soluções para o tema, inclusive criando um software que analisa materiais compartilhados e visuallizados de abuso sexual infantil (CSAM). “Este é um campo de pesquisa desafiador, em grande parte devido à inacessibilidade dos dados de destino que são – e devem ser para sempre – privados e de posse exclusiva dos órgãos investigativos. Assim, extrair insights de dados não vistos e fornecer com segurança maior compreensão das imagens CSAM é primordial, inclusive para que a justiça seja acionada e tais crimes sejam reprimidos”, afirmou Camila.

O projeto em questão visa revelar, de forma agregada, características gerais de imagens CSAM. Para isso, foi concebido um modelo de análise que vai além das estatísticas do conjunto de dados e respectivos rótulos. Mais especificamente, o modelo se baseia em características extraídas das imagens de forma automática. Tais características, ou sinais automáticos, são obtidas através de métodos de aprendizado de máquina pré-treinados para indicar, por exemplo, quais categorias de objetos (cadeira, mesa, óculos, carro, etc.) estão presentes numa dada imagem, ou ainda se a imagem possui ou não conteúdo pornográfico. Também são utilizados métodos para obter características mais genéricas das imagens, tais como luminância e nitidez. “Apenas estatísticas agregadas de sinais esparsos são fornecidas para garantir o anonimato das crianças e adolescentes vitimados. O pipeline permite filtrar os dados aplicando limiares a cada sinal especificado e fornece a distribuição de tais sinais dentro do subconjunto, correlações entre sinais, bem como uma avaliação de viés. Assim, demonstramos nossa proposta no conjunto de dados de pornografia infantil anotado baseado em região (Region-based annotated Child Pornography Dataset – RCPD), um dos poucos benchmarks de CSAM na literatura, composto por mais de 2.000 amostras entre imagens regulares e CSAM, produzidas em parceria com a Polícia Federal do Brasil”, explica a doutoranda.

Camila também relatou que embora sejam ruidosos e limitados em vários sentidos, os sinais automáticos podem destacar aspectos importantes da distribuição geral dos dados, o que torna-se valioso para bancos de dados que não podem ser divulgados. Além da parceria da Polícia Federal, outros órgãos públicos investigativos já tiveram acesso aos resultados da pesquisa e o estão colocando em prática.

De acordo com João Macedo, que além de doutorando do DCC/UFMG é perito da Polícia Federal, o trabalho é uma grande contribuição para esta área de pesquisa e preenche uma importante lacuna. “Esse trabalho possibilita que pesquisadores conheçam características desse tipo de dado sem ter acesso direto a eles. Além disso, permite a visualização de tendências e vieses em uma base de dados representativa desse universo, o que é decisivo para a produção de modelos de detecção mais eficientes e capazes de identificar imagens não conhecidas previamente, acrescentou.

Os resultados da pesquisa serão apresentados na trilha principal da principal conferência sobre Ética na utilização de Inteligência Artificial, a ACM Conference on Fairness, Accountability, and Transparency (Conferência sobre Justiça, Responsabilidade e Transparência), que acontecerá de 21 a 24 de junho, em Seul, na Coreia do Sul.

Esta matéria teve repercussão na mídia, como: CBN, Jornal Nacional da TV Globo, Rádio Itatiaia, Globo News