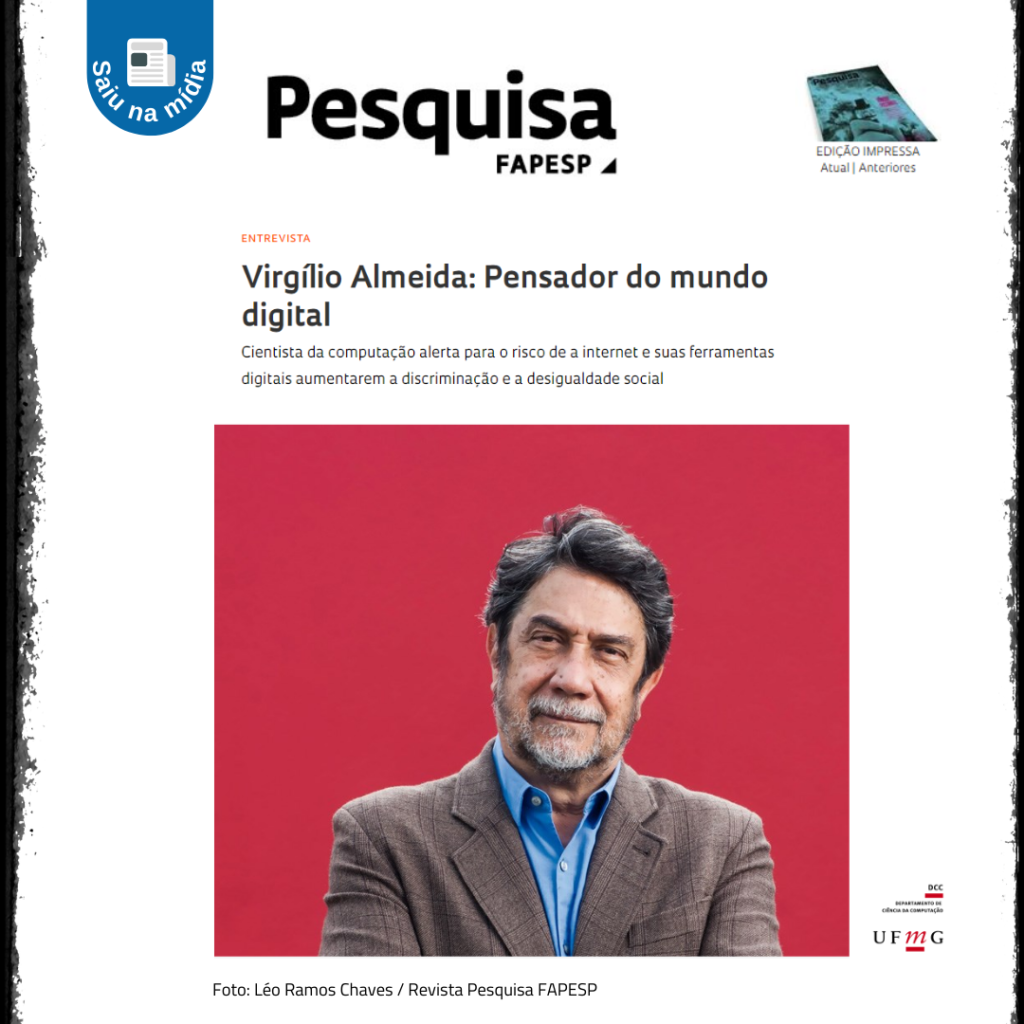

O professor do Departamento de Ciência da Computação (DCC) da UFMG, Virgilio Almeida, concedeu uma longa entrevista aos jornalistas Carlos Fioravanti e Yuri Vasconcelos, da Revista Pesquisa, da Fundação de Amparo à Pesquisa do Estado de São Paulo (FAPESP), na edição 319 de setembro de 2022. Durante a entrevista, Virgílio apresentou resultados de pesquisas realizadas e alertou para os riscos de a internet e suas ferramentas digitais aumentarem a discriminação e a desigualdade social. Veja abaixo a matéria na íntegra:

Virgílio Almeida: Pensador do mundo digital

Cientista da computação alerta para o risco de a internet e suas ferramentas digitais aumentarem a discriminação e a desigualdade social

Ao longo deste ano e até abril do próximo, o engenheiro e cientista da computação Virgílio Augusto Fernandes Almeida vai examinar, como pesquisador do Instituto de Estudos Avançados da Universidade de São Paulo (IEA-USP), as vantagens e as desvantagens da interação entre as pessoas e os algoritmos, que captam e filtram informações da internet, selecionam notícias, recomendam filmes, decidem sobre a qualidade do tratamento médico para cada paciente, enfim, influenciam e, por vezes, moldam a ação humana e a organização social (ver Pesquisa FAPESP no 266).

Como secretário de Política de Informática do Ministério da Ciência, Tecnologia e Inovações (MCTI), cargo que ocupou entre 2011 e 2016, e coordenador do Comitê Gestor da Internet no Brasil (CGI), esse mineiro de Belo Horizonte participou da elaboração das regras que organizaram o mundo digital no país e acompanhou a gestação do Marco Civil da Internet, aprovado em 2014.

Durante anos, no caderno Pensar do jornal Estado de Minas, e desde 2019 no Valor Econômico, em parceria com o economista Francisco Gaetani, da Fundação Getúlio Vargas, ele traz esses temas para o grande público, frequentemente se valendo de trechos das obras de seus autores preferidos, como o argentino Jorge Luis Borges (1899-1986), o alemão Thomas Mann (1875-1955) e os mineiros João Guimarães Rosa (1908-1967) e Carlos Drummond de Andrade (1902-1987).

Em uma conversa por plataforma de vídeo de sua casa, em um condomínio na serra em Nova Lima, na Região Metropolitana de Belo Horizonte, Almeida expôs suas preocupações e propostas sobre problemas atuais, como a moderação de conteúdo e a definição de papéis do governo, das empresas e dos usuários da internet. Ele é casado com a engenheira Rejane Maria, têm dois filhos, Pedro, de 40 anos, e André, de 38, um neto e outro que chegará nos próximos meses.

Em maio, você publicou um artigo com os cientistas políticos Fernando Filgueiras, da Universidade Federal de Goiás, e Ricardo Mendonça, da UFMG, sobre governança do mundo digital. Como é trabalhar com o pessoal das ciências humanas?

Tem sido ótimo. Estou aprendendo muito. Não é simples fazer um trabalho multidisciplinar. Existe a dificuldade da linguagem, dos padrões das outras áreas de cultura e do conhecimento prévio, mas temos de achar um jeito de avançar. Juntos, estamos escrevendo um livro para a Universidade de Oxford sobre o impacto dos algoritmos nas instituições da sociedade.

As ciências sociais podem contribuir para a governança dos algoritmos?

Sim, e muito, porque os algoritmos e as tecnologias que eles controlam têm um impacto social. Como as pessoas reagem? Como alteram comportamentos em função disso? O mundo digital é um ambiente público, e as pessoas mostram lados desconhecidos e não civilizados, principalmente nos comentários. É um mundo que, facilmente, pode enganar. Escrevi durante muitos anos para o Estado de Minas, sempre tentando combinar a literatura com as tecnologias computacionais para ajudar as pessoas a verem outros lados da realidade. Em um artigo, usei um livro do escritor argentino Bioy Casares [1914-1999], em que o narrador se apaixona por uma moça bonita. Era um amor impossível, porque as imagens dela eram criação de uma máquina.

Outro artigo seu, de 2016, com o advogado Danilo Doneda, já tratava da governança por e dos algoritmos.

Conheci Danilo, um especialista em proteção de dados pessoais, quando trabalhei em Brasília, e começamos a discutir a governança dos e por algoritmos. O que significa isso? As plataformas digitais são governadas por algoritmos. Não tem gente trabalhando nas plataformas. Os algoritmos governam as plataformas dizendo o que vai ganhar visibilidade com base nos dados e gostos pessoais que elas cada vez coletam mais. Essa é a governança por algoritmo, que tem se expandido para outros casos. No setor financeiro, é o algoritmo que diz se uma pessoa pode ou não receber um empréstimo. No transporte por aplicativo, é o algoritmo que vai dar o trajeto e o preço da passagem. Em um mundo de quase 8 bilhões de pessoas, com inúmeros problemas, os algoritmos são essenciais para controlar o fluxo aéreo e a distribuição de energia. São essenciais, mas também decidem sobre a vida das pessoas de modo nem sempre considerado justo. Os potenciais problemas disso são: discriminação, exclusão de grupos e injustiça. O outro lado é a governança dos algoritmos, entender como funcionam e como deve ser exigido deles algum tipo de transparência. Nos Estados Unidos, vários tribunais usam um programa chamado Compass, que mostra se um réu tem direito ou não à liberdade condicional. Nem o governo nem os juízes sabem os critérios de análise desse algoritmo. Os criadores do programa não abrem porque alegam se tratar de segredo comercial, com base na legislação do país.

O que tem sido proposto a respeito da governança dos algoritmos?

O governo e a sociedade civil de vários países têm discutido essa questão. Um ponto sobre o qual já existe algum consenso é que os algoritmos têm que ser justos, transparentes e explicáveis. São critérios muito difíceis de aplicar, porque um algoritmo é um código complexo de dados que muda a cada instante. A maior parte deles usa aprendizado de máquina e varia de acordo com o que está aprendendo. Na Europa, uma das preocupações é que os algoritmos devem ser explicáveis para uma pessoa que se sinta prejudicada por uma decisão. Quando Danilo e eu escrevemos esse artigo, queríamos aplicar as ideias de governança da internet na governança dos algoritmos, estabelecendo, por exemplo, que eles deveriam seguir regras preestabelecidas por comissões multissetoriais em cada país.

Deu certo?

Não, porque o problema continua. Há dois anos, um aluno de mestrado, Manoel Ribeiro, orientado pelo meu colega Wagner Meira Jr. e por mim, fez um trabalho que teve impacto mundial. Ele estudou como as opiniões das pessoas vão se radicalizando nos grupos do YouTube com diferentes gradações políticas. Mostrou que uma pessoa poderia começar em um grupo, no centro, e evoluir para a radicalização, que defendia a supremacia branca (ver Pesquisa FAPESP no 287). Mas não conseguimos identificar o papel do algoritmo. Tudo isso é medido do lado de fora. Não conseguimos acessar o lado de dentro, porque as empresas não abrem os algoritmos. Isso é muito grave.

Não devemos levar para o espaço on-line a desigualdade do espaço físico, mas não é o que se vê

O que mais seu grupo tem estudado?

Um aluno que terminou o doutorado em 2019, Gabriel Magno, fez a seguinte pergunta: os valores sociais e morais migram do mundo físico para o mundo on-line? Para responder, ele analisou 1,2 bilhão de tweets, usando uma base de pesquisa sociológica, a Word Value Server [WVS], e técnicas de inteligência artificial para mapear os tweets de 50 países. Em alguns, as visões do mundo físico e digital coincidem, mas em outros são diferentes, por causa do acesso e das restrições de gênero. No Oriente, as mulheres têm muito mais limitações para se manifestar. No Brasil, alguns valores coincidem e outros não. A Argentina é muito interessante: a questão do aborto vista por um sociólogo é diferente da do movimento mais progressista que aparece na internet. Magno participou de um trabalho com uma ex-aluna, Camila Araújo. Ela criou um robô que ia nas ferramentas de busca Google e Bing em 42 países e procurava por mulheres bonitas e mulheres feias. Ela optava pela resposta de imagem e usava um algoritmo de inteligência artificial para estimar a faixa de idade, a raça e a cor das pessoas que respondiam. Caímos para trás vendo os resultados.

O que eles apontaram?

Na Nigéria e no Quênia, o padrão de beleza era mulher loira e nova. Isso é muito importante, porque os jovens vão se mirar nisso para se posicionar no mundo. Para ver por que isso acontecia, Camila e Gabriel começaram a levantar de onde vinham as fotos que representavam mulher bonita e mulher feia. Viram que as imagens poderiam ser agrupadas em torno das linguagens, inglês, espanhol, português, chinês. No grupo do inglês, eram dominadas pelos países mais ricos, como Estados Unidos, Canadá, Austrália e Inglaterra. Os países da África colonizados, que falavam inglês, recebiam as imagens, mas não representavam a população deles. Para ter um resultado que seja compatível com a demografia do lugar, era preciso fazer uma opção de busca local, não global.

Ou seja, a forma como coletamos os dados interfere no resultado da pesquisa.

Sim. Uma linha de pesquisa muito recente nos Estados Unidos e na Inglaterra trata exatamente disso. É o data colonialism ou colonialismo de dados. É um assunto preocupante, porque as grandes empresas precisam dos dados do mundo inteiro para treinar os algoritmos faciais e fazer recomendações de sites ou notícias, mas os países mais pobres não têm o domínio da tecnologia, só têm os dados, que cedem sem saber e sem querer. É como uma ação colonialista, porque as grandes empresas operam nesses países, extraindo não mais o recurso natural, mas a informação, que usam para ampliar seu domínio econômico.

Quais as discussões de seu grupo da Universidade Harvard?

O Centro Berkman Klein para Internet e Sociedade foi criado há mais de 20 anos. Multidisciplinar, é próximo da escola de direito, mas também envolve as de engenharia, computação e medicina. Desigualdade econômica e social e discriminação racial, étnica e de orientação sexual são os temas que permeiam grande parte dos afiliados e grupos de pesquisa. A diferença entre o território físico e o digital é outro tema quente. A governança é estabelecida, na maior parte dos casos, por poucas empresas situadas no hemisfério Norte, em especial nos Estados Unidos. Pergunto: elas se aplicam ao mundo digital inteiro? As regras deveriam ser as mesmas?

O que você pensa?

Claro que não deveriam. As culturas e os hábitos são diferentes. A desigualdade entre países ricos e pobres é tremenda. Uma de minhas inquietações é que a governança do mundo digital está sendo feita não só por governos, mas também por empresas, que conseguem monitorar muito mais do que os serviços secretos de países e podem usar as informações com intuito totalitário. Outra preocupação é que não devemos levar para o espaço on-line a desigualdade do espaço físico, mas não é o que se vê. Pesquisadores norte-americanos analisaram milhões de dados sobre a internação de pessoas em hospitais do país. O algoritmo que fazia a recepção e determinava o encaminhamento do paciente definia o limite de custos do tratamento, em função do seguro saúde. Os pesquisadores viram que, para duas pessoas que se internam com o mesmo nível de gravidade, uma negra e outra branca, o algoritmo atribui um orçamento menor à negra. Com isso, os médicos teriam menos recursos para tratar dos pacientes negros. O mais impressionante é que os dados desse programa, usado para planejar o atendimento, coincidiam com o comportamento dos hospitais do sistema de saúde. A pesquisa evidenciou uma discriminação, que poderia ser corrigida.

De que modo?

Esses sistemas pertencem a empresas, que têm objetivos comerciais. Mas a computação e a engenharia podem ter o papel de identificar essas falhas sociais, como a discriminação, mostrar para a sociedade como essas plataformas operam e refutar os argumentos das empresas. Em 2015, a então presidente Dilma Rousseff foi convidada para uma visita aos Estados Unidos. Fiz parte da comitiva, porque era secretário de Política de Informática do MCTI. Em uma reunião organizada pela ex-secretária de Estado americana Condoleezza Rice estavam, entre outros, o Mark Zuckerberg, do Facebook, Erick Schmidt, do Google, Dara Khosrowshah, da Uber, todos em uma sala e a presidente no centro, respondendo às perguntas deles. Fiquei atrás, observando. Nenhum desses megaempresários perguntou se o Brasil daria algum incentivo para atrair as empresas deles, mas fizeram perguntas de ordem operacional e regulatória, se algo poderia ou não ser feito e quais eram as regras. As empresas, pelo menos boa parte delas, querem regras, que a gente chama de regulação, porque criam segurança e podem minimizar problemas. Um deles, bem difícil de se resolver, é a moderação de conteúdo.

Por quê?

A moderação de conteúdo é local e depende do idioma, da cultura e do prestígio político e econômico de cada região. No Facebook, grande parte dos recursos de moderação é dedicada a cinco países de língua inglesa; para línguas e países menos importantes, é muito menos elaborada. A moderação também é difícil porque um conteúdo que hoje poderia ser aceito em certos grupos muitas vezes é considerado ofensivo em outros. A tecnologia pode resolver? Em parte, porque milhões de vídeos sobem a cada minuto e centenas de milhões de mensagens se tornam disponíveis para todos a cada dia. A moderação de conteúdo requer algoritmos e o apoio de um exército de pessoas para agir quando os algoritmos ficam na faixa cinzenta, quando não se sabe se algo poderia ou não ser aceito. Os algoritmos pegam pornografia infantil, mas há um nível de sutileza muito grande em temas políticos e religiosos. É importante que as leis responsabilizem as empresas sobre os conteúdos indesejados e elas possam aperfeiçoar seus sistemas. É um problema complexo dessa nova sociedade digital global.

Já há princípios nessa nova ordem digital?

Alguns países estão formulando regras. A União Europeia criou uma legislação, a Digital Service Act, que ainda não entrou em vigor. A Alemanha definiu o que é conteúdo ilegal on-line; o país já tinha uma regulação voltada ao off-line, por causa do nazismo. Um fundamento na Europa é: os direitos e as responsabilidades off-line têm de permanecer no on-line. No Brasil, o PL 2.630 [Projeto de Lei nº 2.630/20, que institui a Lei Brasileira de Liberdade, Responsabilidade e Transparência na Internet] estabelece esses limites, mas parou no Congresso. O que tenho visto é que as crises fazem as coisas andarem. O Marco Civil da Internet saiu depois que o Edward Snowden vazou informações de segurança dos Estados Unidos em 2013 e a Lei Geral de Proteção de Dados Pessoais depois do caso da Cambridge Analítica [empresa britânica que em 2014 recolheu informações de até 87 milhões de usuários do Facebook e as utilizou para influenciar a opinião de eleitores em vários países]. As regras também têm de ter uma dosagem porque, se você define certos conteúdos como ilegais, pode ser que as empresas de tecnologia, com receio de multas ou de penalidades, se antecipem, comecem a barrá-los e passem a exercer censura política ou econômica.

Para governar o espaço digital, temos de reunir todos os participantes, governo, empresas e sociedade civil

Você trabalhou em empresas durante 10 anos, antes de se tornar professor da UFMG, em 1989. O que fez?

No quarto e quinto anos do curso de engenharia, fui estagiário do centro de computação da UFMG. Depois, em 1973, quando me formei, fiz concurso para a área de sistemas da Petrobras, no Rio. Dois anos depois, tive uma oferta, voltei para Belo Horizonte e fiquei oito anos no setor de planejamento de sistemas na Cemig [Companhia Energética de Minas Gerais]. Lá, eu tentava entender como funcionavam aqueles sistemas e imaginar como poderia melhorar sua função. Tudo era distante das pessoas, tanto que o computador ficava em uma redoma. Me mandaram fazer o mestrado e fui. Meu orientador na PUC [Pontifícia Universidade Católica] do Rio era Daniel Menasce. Viramos amigos e escrevemos seis livros juntos. Os anos de empresa me ajudaram muito a focar e buscar resultados. Quando terminei o mestrado, fui me interessando por novas questões e pensei em fazer o doutorado nos Estados Unidos. Meu pai falou assim: “Acho uma insanidade você largar um emprego bom e ir para os Estados Unidos com dois filhos pequenos”. Fui mesmo assim, e depois de muitos anos vi que meu pai estava certo. O retorno ao Brasil foi difícil, porque não tinha vínculo formal de emprego, e fiquei dois anos como bolsista aguardando abertura de concurso na UFMG, pois queríamos continuar morando em Belo Horizonte.

Como foi seu trabalho no governo?

No final de 2010, recebi um telefonema de Jorge Kalil, um cientista de São Paulo, me convidando para jantar na casa dele. Ele havia chamado alguns integrantes da Academia Brasileira de Ciências, da qual eu já era membro, para conversas sobre ciência e tecnologia. Nesse jantar estava o senador Aloizio Mercadante, que viria a ser o ministro dessa pasta. Mercadante queria que eu assumisse a Secretaria de Política de Informática, uma das cinco do ministério. Eu nunca tinha estado no governo. Fiquei muito preocupado, porque Brasília é outro mundo, mas um amigo da faculdade de filosofia me deu um conselho interessante: “Nos relacionamentos em Brasília, fique sempre na sala, nunca entre na cozinha. Mantenha uma distância formal”. Foi muito útil. Fiquei cinco anos em Brasília.

Como foi esse período?

A secretaria tinha a função de formular e acompanhar as políticas, na época, de informática – hoje talvez fosse chamada de políticas digitais. Como secretário, eu era também o coordenador do Comitê Gestor da Internet, o CGI, criado em 1995. No CGI, aprendi sobre os problemas de governança da internet, ou seja, que seria preciso estabelecer regras de modo que a sociedade pudesse acompanhar o funcionamento desse território digital e participar de sua organização. A internet começava a crescer muito e a entrar em negócios e em governos, mas ainda não havia regras. Ocorreu um fato que deu uma dimensão maior à secretaria e fez com que eu tivesse um papel mais ativo do que imaginava.

Que fato foi esse?

No final de 2013, explodiram as revelações de Snowden sobre as espionagens do governo norte-americano pelo mundo. Elas mostraram, inclusive, que a presidente Dilma e empresas brasileiras, como a Petrobras, haviam sido espionadas. A presidente nomeou formalmente uma comissão para tratar dessa questão: “Precisamos ter uma resposta do país e pensar quais são as regras para a internet”, recomendou. O caso Snowden deixou o mundo preocupado, sem saber o que fazer com a crescente espionagem digital. Havia um desconforto também com o fato de que a organização responsável por estabelecer nomes e domínios, os endereços na internet, a Icann [Internet Corporation for Assigned Names and Numbers, Corporação da Internet para Atribuição de Nomes e Números], estava na Califórnia e, portanto, sujeita à legislação local, embora o impacto fosse global. A resposta do Brasil foi levantar a necessidade de uma reunião global. No fim de 2013, eu estava em uma reunião em Seul na Coreia do Sul e recebi um telefonema do ministro Marco Antonio Raupp [1938-2021]: “Vá para Bali, Indonésia, porque vamos começar um processo para criar uma reunião internacional no Brasil para discutir essa questão da espionagem e o futuro da internet”. Participei de várias reuniões em Londres com o objetivo de montar uma grande reunião internacional, que passou a ser chamada de NETmundial. Não era uma reunião de governo. É difícil pensar a governança da internet exatamente porque não se trata apenas de governo. Os cabos submarinos e toda a infraestrutura da internet são de empresas privadas de telecomunicações. O desenvolvimento dos conteúdos e serviços digitais é da sociedade. Nos servidores, rodam softwares de uso livre. É um mundo que não é de governos, embora os governos tenham, cada vez mais, a pretensão de governar. Há a sociedade civil, o setor privado e a academia, já que parte de tudo isso nasceu de projetos acadêmicos nos Estados Unidos, financiados pelo setor militar. É um espaço multissetorial. Para governar isso, tem de colocar junto todos os participantes. Era justamente a missão do CGI brasileiro. São 21 membros, nove de governo, quatro de setor privado, quatro de ONG [organizações não governamentais], três da comunidade acadêmica e um representante de notório saber em assuntos de internet, indicado pelo ministério. Nenhum setor tem, isoladamente, a maioria dos votos.

Como fecham as decisões?

Tudo tem de ser negociado. A negociação demora, mas, uma vez obtido o consenso, a decisão tem duração e aceitação mais abrangentes do que se fosse unilateral. Durante os cinco anos em que eu fui o coordenador, evitei votações, porque a votação separa e cria grupos. É preferível que o processo se estenda e se encontre um denominador comum. É dificílimo, mas, com paciência, dá certo. Eu era apenas o coordenador e tentava achar um consenso. Para viabilizar a NETmundial em abril de 2014, a presidente trabalhou com líderes do Congresso para aprovar a legislação do Marco Civil da Internet. O grande ponto de interrogação era a chamada neutralidade de redes. As empresas não queriam neutralidade de rede, mas a questão política levou o Congresso a aprovar e, na abertura da reunião da NETmundial, em 23 de abril de 2014, a presidente sancionou a Lei do Marco Civil da Internet.

O que é a neutralidade de rede?

As comunicações na internet utilizam protocolos chamados TCP/IP [protocolo de controle de transmissão/protocolo da internet]. Os conteúdos são quebrados em pequenos pacotes e transitam pela rede. Têm origem e destino. A neutralidade de rede implica que as empresas por onde passam os pacotes não podem tratar diferentemente os pacotes em razão da origem ou do destino. Elas têm que ser neutras, não podem interferir. Na época isso era importante porque estabelecia que uma empresa de telecomunicação não poderia bloquear o Skype, por exemplo, mesmo se concorresse com o serviço dela de voz. Outra preocupação é que essas empresas não poderiam dar um tratamento especial a um determinado serviço ou outro.

Quero identificar formas de colaboração que preservem a individualidade e não deixem o algoritmo fazer tudo

As empresas aceitaram a neutralidade?

Foi uma negociação difícil, mas o Marco Civil da Internet dava uma garantia às empresas, porque gerou um ambiente estável e seguro. Estava na lei que qualquer conteúdo só poderia ser removido com uma ordem judicial. Se não fosse o marco civil, a confusão na eleição de 2018 poderia ser ainda maior, porque um político poderia querer tirar da internet um conteúdo que o desagradasse. O Brasil foi um dos pioneiros na neutralidade de rede e na organização multissetorial da internet. Tínhamos um prestígio imenso. À NETmundial, compareceram 1.100 pessoas, de mais de 100 países, ministros de Estado e 100 jornalistas internacionais. Os debates eram ao vivo e havia 30 hubs internacionais. Os grupos discutiam os temas sempre em salas separadas e a tela onde se faziam as alterações de textos era projetada para todo mundo ver o que estava sendo operado. Nas reuniões formais, tinha um palco grande com quatro microfones: um para representantes dos governos, um para o setor privado, um para a sociedade civil e outro para a comunidade técnica e acadêmica. Se alguém de um governo falava, o próximo não poderia ser de outro governo, teria de esperar os representantes dos outros três setores.

O que saiu dessa conferência?

Dois documentos, o primeiro, com 10 princípios para a governança da internet, e outro, um road map, um caminho para o futuro. A aprovação foi por aclamação. Só três países, Índia, Cuba e Rússia, não aceitaram os documentos. O prestígio que o Brasil ganhou foi enorme. Em 2017, me convidaram para integrar uma comissão internacional de 25 pessoas para discutir normas para a segurança do ciberespaço. Essa comissão se reuniu durante dois anos em vários países, mas não veio ao Brasil, porque já haviam ocorrido mudanças no governo. Perdemos relevância.

Em abril você assumiu a cátedra Oscar Sala do Instituto de Estudos Avançados da USP.

Quais são os seus planos?

O tema que escolhi é a interação humano-algoritmo, porque sofremos a influência dos algoritmos o tempo todo. Quando você está assistindo a um filme na Netflix, o algoritmo, repentinamente, sugere outra coisa e, muitas vezes, você aceita e segue para outro filme. Os chamados algoritmos de recomendação tentam direcionar o comportamento das pessoas. Muitas vezes ocorre o que a gente poderia chamar de efeito manada, quando o algoritmo joga em uma direção indesejada, deixando de lado o que as pessoas realmente querem. Precisamos entender melhor essa redução da função do ser humano e o aumento da função do algoritmo. Tem um termo interessante no meio, complacência, quando a gente se acostuma com as coisas e segue o que o Google indica. Mas será que o que ele me recomenda naquela consulta é o que eu realmente deveria olhar? Quero entender essa interação de um ponto de vista mais amplo, não só da computação, mas das ciências humanas. O que me preocupa é também identificar outras formas de colaboração, que preservem a individualidade e não deixem o algoritmo fazer tudo.

Foto: Léo Ramos Chaves / Revista Pesquisa FAPESP